[이 기사에 나온 스타트업에 대한 보다 다양한 기업정보는 유니콘팩토리 빅데이터 플랫폼 ‘데이터랩’에서 볼 수 있습니다.]

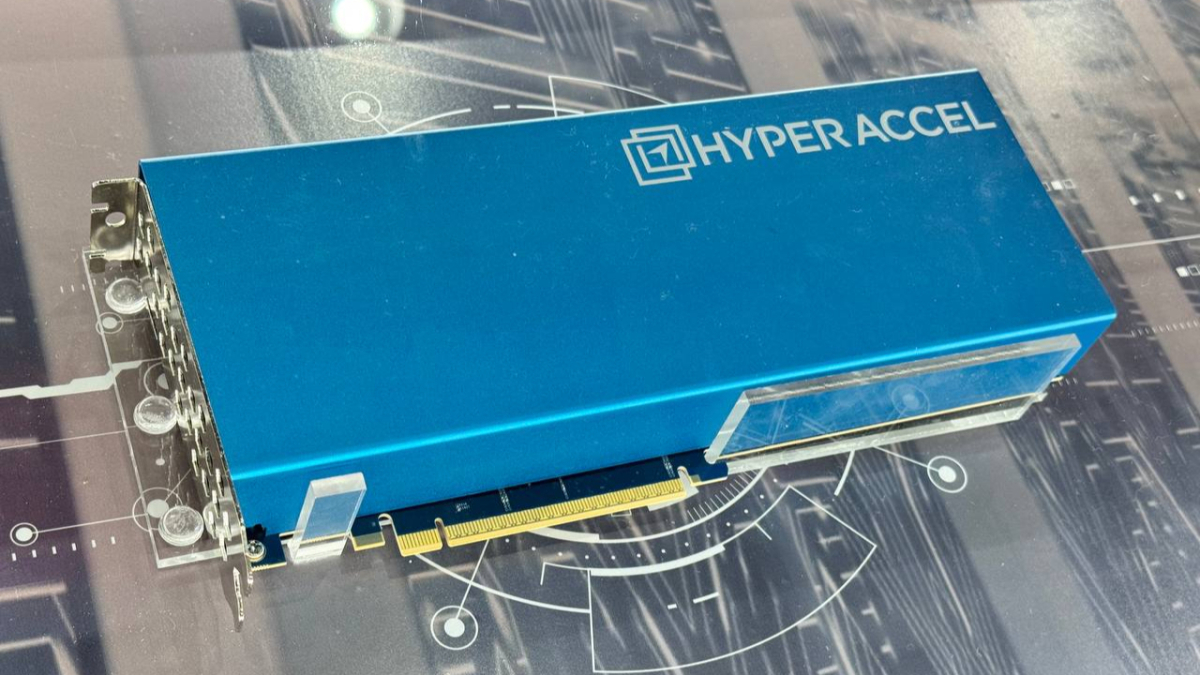

AI(인공지능) 반도체 스타트업 하이퍼엑셀이 데이터센터향 LPU(거대언어모델(LLM)처리장치) 반도체 '베르다' 보드 제품을 공개했다. 하이퍼엑셀의 첫 완제품으로, 고가의 HBM(고대역폭메모리) 대신 LPDDR(저전력D램)을 사용하면서도 연산 성능은 유지하는 게 특징이다. 하이퍼엑셀은 안정화작업을 거쳐 내년 상반기 양산한다는 계획이다.

하이퍼엑셀은 7일 서울 강남구 코엑스에서 열린 AI엑스포코리아 2026에서 1세대 LPU '베르다' 보드 제품을 공개했다. 베르다는 하이퍼엑셀이 개발한 LLM 추론에 특화된 반도체다. NPU(신경망처리장치)가 범용 AI 추론에 최적화됐다면, 이 LPU는 LLM 추론에만 최적화해 사용범위를 좁히되 성능을 극대화했다.

하이퍼엑셀의 베르다는 반도체의 '메모리 병목'을 줄여 연산효율성을 높인 것이 특징이다. 통상 GPU(그래픽처리장치) 등 AI반도체는 연산을 위해 D램에서 S램으로 데이터를 옮긴 뒤 연산하고 다시 결과데이터를 메모리에 저장한다. 이렇게 메모리 간 데이터가 옮겨가는 과정에서 병목현상이 발생하는데, 이 과정을 최소화해 효율성을 높였다는 게 회사 측 설명이다.

이진원 하이퍼엑셀 CTO(최고기술책임자)는 "D램에서 LPU로 바로 데이터가 들어오고 연산이 끝나면 바로 결과를 내보내게 아키텍처를 설계했다"며 "그 결과 HBM보다 가격이 저렴하고 전력효율도 높은 LPDDR을 활용해도 LLM을 구동시키는 데 속도나 성능에 문제가 없다"고 말했다.

베르다를 사용하는 데이터센터 사업자들이 H200 대비 운영비(TCO)를 최대 5.4배 낮출 수 있다는 점도 강조했다. 베르다의 연산 성능이 384TFLOPS로 엔비디아의 하이엔드급 반도체 H200(990TFLOPS)보다 낮지만, 실질적인 AI처리 속도에선 차이가 없고, 전력사용량은 4.5배 낮아서다.

하이퍼엑셀은 해당 제품을 내년 상반기 양산한다는 계획이다. 양산 후에는 네이버클라우드 데이터센터 적용을 목표로 현재 협업이 진행되고 있다. LG전자와 함께 가전에 활용될 온디바이스AI용 LPU도 개발 중이다.

독자들의 PICK!

이 CTO는 "하이퍼엑셀은 AI의 서비스 비용 최소화를 추구한다"며 "낮은 전력사용량 등을 토대로 월 5000원이면 누구나 AI를 사용할 수 있는 시대를 만들겠다"고 말했다.