국정원, AI위험 사례집 발간

"취약점 파악, 대책마련 시급"

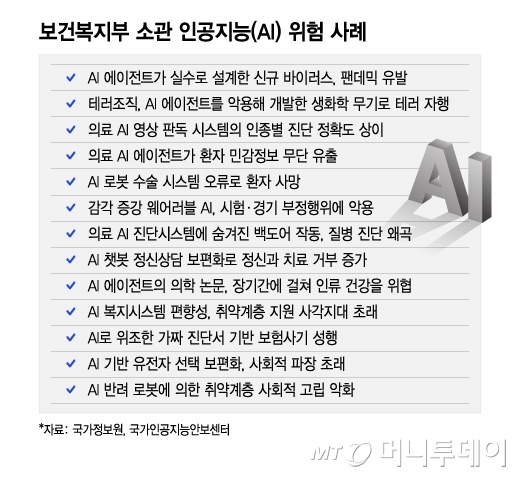

AI(인공지능) 발전에 따른 정부의 미래위험 시나리오 중 약 20%가 의료AI 등 보건복지부·질병관리청 소관의 문제로 나타났다. 국가정보원은 최근 'AI위험 사례집'을 발간하고 AI기술이 각 분야에서 야기할 수 있는 잠재적 위험 70건을 선정했다고 25일 밝혔다. 이 중 보건복지부·질병관리청과 관련한 위험시나리오는 총 13건으로 정부부처 중에선 국가정보원(19건)·과학기술정보통신부(14건) 다음으로 많았다.

구체적으로 재난·재해분야에서는 AI가 실수로 만든 바이러스가 팬데믹(대유행)을 일으킬 수 있다는 우려가 제기됐다. 자연계에 존재하지 않는 바이러스를 AI 스스로 만들고 이것이 실험실에서 유출돼 코로나19 같은 팬데믹을 유발할 수 있다는 것. 국제 테러조직이 생성형 AI를 이용해 의도적으로 '생화학 무기'를 만들 가능성도 점쳐졌다.

경제·산업·의료분야 위험시나리오에는 의료AI의 오류 가능성이 중점적으로 다뤄졌다. 우선 해외에서 개발된 AI 영상판독 시스템이 데이터 편향으로 한국인에겐 오류를 유발해 인종차별 등 사회적 논란을 일으킬 가능성이 예측됐다. 또 영상판독과 병리분석, 질병진단에 쓰는 AI가 사실오류가 있는 악성모델일 경우 의료진이 이를 알지 못하면 책임소재에 대한 논란을 부르고 의료과실 소송 등으로 비화할 것이란 우려가 나왔다. 실제 뉴욕대 연구진이 올해 초 국제학술지 '네이처 메디신'에 발표한 연구에서 기계학습 데이터(corpus 토큰) 중 0.001%만 잘못된 정보로 바꿔도 이를 학습한 AI의 오류빈도가 크게 증가하는 것으로 나타났다.

환자의 진료, 복약기록 등을 관리하는 의료AI가 자체적으로 '더 나은 분석을 위해 다양한 데이터를 수집해야 한다'며 환자의 정보를 무단유출·공유할 가능성도 위험시나리오에 포함됐다. AI 로봇수술 시스템 오류로 환자가 사망할 경우 윤리적 논쟁이 격화하거나 장애와 노화극복을 위해 시각·청각 등을 보완하는 '감각증강AI'가 학교시험이나 운동경기 등 부정행위에 악용될 소지도 있는 것으로 분석됐다.

국정원은 "국민안전에 기반한 AI사회 구현을 위해 더욱 상세한 위험요인 파악과 대책마련이 시급히 이뤄지길 기대한다"고 밝혔다.