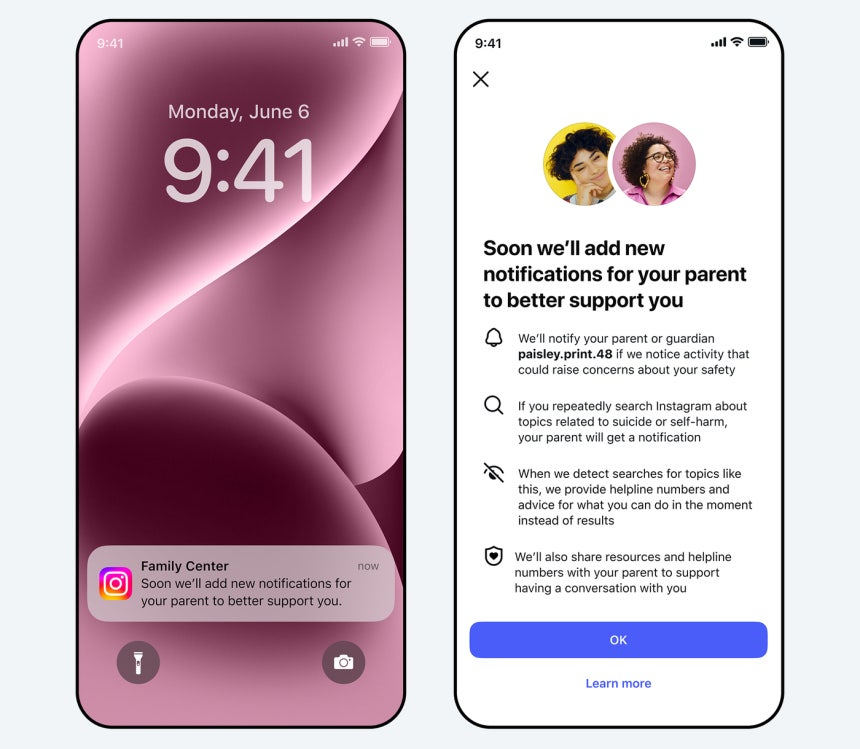

앞으로 청소년이 인스타그램에서 '자살', '자해' 등 용어를 반복해서 검색하면 부모 등 보호자에게 알림이 간다.

인스타그램을 운영하는 메타는 26일(현지 시간) 부모 감독 기능을 사용하는 인스타그램 이용자를 대상으로 이같은 신규 알림 기능을 도입했다고 밝혔다.

해당 기능은 다음 주부터 미국, 영국, 호주, 캐나다에서 먼저 적용된다. 한국을 비롯한 다른 지역은 올해 말부터 해당 서비스를 사용할 수 있다.

이 기능은 부모 동의를 받고 운영되는 청소년 계정에 도입된다. 보호자는 이메일, 문자, 왓츠앱, 앱 내 알림 등으로 통보받는다. 인스타그램 측은 자녀가 관련 검색을 반복했다는 사실과 함께 전문가 상담, 대화 접근 가이드 등 지원 자료도 제공한다.

다만 불필요한 알람을 방지하기 위해 단순 검색이 아닌 짧은 시간 내에 해당 주제를 여러 차례 검색하는 경우에만 알림을 보낸다.

메타 측은 "이번 기능은 청소년을 유해 콘텐츠로부터 보호하기 위한 노력의 일환"이라며 "인스타그램에서는 자살, 자해 조장이나 미화 콘텐츠에는 엄격한 정책을 시행 중이다. 청소년에게 관련 콘텐츠가 노출되지 않도록 차단할 것"이라고 설명했다.

※우울감 등 말하기 어려운 고민이 있거나, 주변에 이런 어려움을 겪는 가족 · 지인이 있을 경우 자살예방 상담전화 ☎109 또는 SNS상담 '마들랜'에서 24시간 전문가의 상담을 받을 수 있습니다.